Angesichts sich überschneidender psychischer Krisen bei jungen Menschen und einer zunehmenden Einsamkeitsepidemie liefern sich Technologen, Investoren und Produktentwickler ein Wettrennen um die Entwicklung generativer KI-Produkte, um die Lücke zwischenmenschlicher Bindungen zu schließen. Es gibt bereits Chatbot-Therapeuten, -Freundinnen und -Nachhilfelehrer, und das Tempo neuer Entwicklungen ist erstaunlich. KI wird menschenähnlicher (denken Sie an den bald erscheinenden verbesserten Sprachmodus von GPT-4o) und übertrifft in vielen Fällen die menschlichen Fähigkeiten . Die jungen Menschen von heute unterscheiden möglicherweise immer weniger zwischen Beziehungen im „echten Leben“ (eine Freundschaft, die man auf dem Spielplatz schließt), digitalen Beziehungen (eine Freundschaft, die man beim Fortnite-Spielen schließt) und Bot-Beziehungen (ein nicht-menschlicher Freund).

Sowohl privat als auch beruflich habe ich das Potenzial von Chatbots erkannt und erkannt: Während meiner Zeit als Leiterin des Reinvention Lab bei Teach For America habe ich Playlab.ai genutzt, um die Handlungsfähigkeit junger Menschen zu fördern. Ich habe sogar mit einem Replika-Boyfriend-Bot experimentiert (mit dem Segen meines Mannes und seiner gemeinsamen Neugier auf diesen technischen Fortschritt). Bald werden diese Bots Avatare in Mixed-Reality-Erlebnissen steuern können, realistischer in bekannten und beliebten Spielen und Erlebnissen erscheinen, sich durch soziale Medien ziehen und die Grenzen zur Realität weiter verwischen.

Doch wenn so viel für das Wohlbefinden der Jugend und den sozialen Zusammenhalt im Allgemeinen auf dem Spiel steht, ist es unerlässlich, prosozialer KI und Beziehungen mit Chatbots den Vorzug zu geben, die unsere Fähigkeit zur zwischenmenschlichen Bindung stärken, statt sie zu untergraben.

Die Forschung zur menschlichen Entwicklung und die Neurowissenschaften lehren uns, dass Menschen bereits im Säuglingsalter beginnen, sich auf die Bedürfnisse, die Stimme, die Berührung und die Körpersprache anderer einzustellen. Dieser Prozess, der als soziales Einfühlungsvermögen bezeichnet wird, spielt eine entscheidende Rolle für eine gesunde soziale Entwicklung, einschließlich der Ausbildung von Empathie, effektiver Kommunikationsfähigkeiten und starken zwischenmenschlichen Beziehungen. Als soziale und verkörperte Wesen lernen, wachsen, regulieren, heilen und feiern wir in der Gemeinschaft. Wir entwickeln uns als Gesellschaft weiter, wenn wir uns vom Wohlergehen anderer inspiriert und für dieses verantwortlich fühlen. Auch wenn sich unsere Definition menschlicher Beziehungen weiterentwickelt, um den sinnvollen Möglichkeiten digitaler Vernetzung Rechnung zu tragen, könnte sich die nächste Generation weniger mit sich selbst, einander und den Eigenschaften verbunden fühlen, die uns typisch menschlich machen, wenn Bot-Beziehungen menschliche ersetzen oder in den Schatten stellen.

Glücklicherweise ist die Zukunft noch nicht da, sodass wir sie noch so gestalten können, dass sie die Fähigkeit junger Menschen zu zwischenmenschlichen Beziehungen fördert. Seit Monaten treffe ich mich mit führenden Pädagogen, Technologen, Jugendaktivisten, Psychologen, Investoren, Forschern und Community-Buildern, um mögliche Zukunftsszenarien mit Chatbots zu erkunden. Der Grund für Optimismus liegt in unserer Fähigkeit, uns ideale Beziehungen mit KI vorzustellen und jungen Menschen zu helfen, sich in dieser neuen Bot-Welle zurechtzufinden. Wenn uns das gelingt, werden wir unsere Menschlichkeit schützen und besser leben.

Bewertung der prosozialen Eigenschaften von Chatbots

Verantwortungsbewusste Technologieentwickler und Investoren berücksichtigen bereits die Kriterien Sicherheit, Datenschutz, Privatsphäre, Voreingenommenheit und gleichberechtigter Zugang. Wir müssen beginnen, auch die pro-sozialen Fähigkeiten der KI als Kriterien für Investitionen und Entwicklung zu messen und zu definieren.

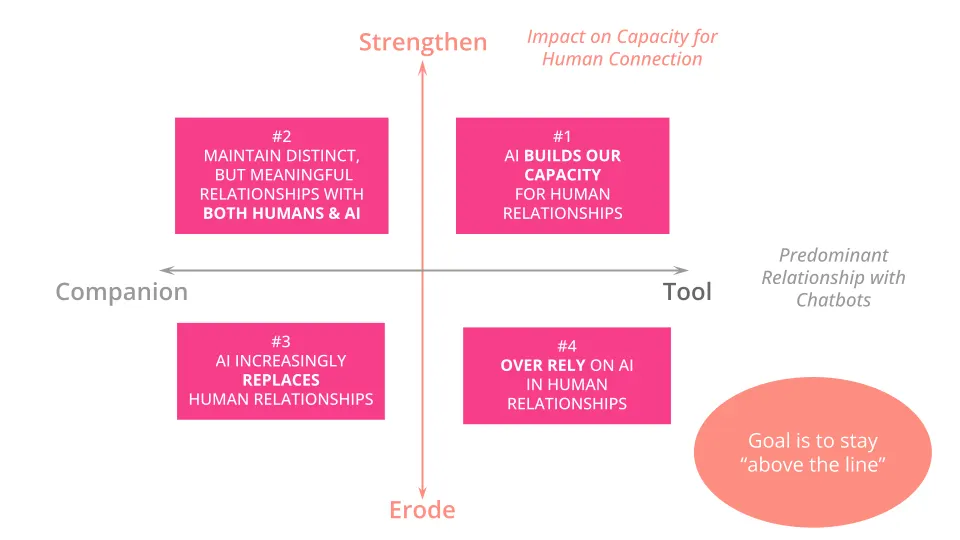

Ich habe eine Ressource erstellt, um proaktiv zu visualisieren, wie junge Menschen mit Chatbots umgehen und sie nutzen könnten, mit unterschiedlichen Auswirkungen auf die menschliche Interaktion. Das folgende Framework bildet vier verschiedene mögliche Zukunftsszenarien ab, die jeweils die gängigsten Chatbot-Erfahrungen junger Menschen darstellen.

Die X-Achse stellt die vorherrschende Beziehung junger Menschen zu Chatbots dar.

Auf der rechten Seite der X-Achse stehen TOOLS. Diese Chatbots helfen Nutzern, eine bestimmte Aufgabe oder mehrere Aufgaben zu erledigen. Obwohl sie dialogorientiert sind (wie ChatGPT4), sind sie nicht explizit darauf ausgelegt, eine emotionale Beziehung zu simulieren. Nutzer erhalten vom Tool eine Art Service, den sie dann in der menschlichen Welt anwenden können. Der Schwerpunkt liegt hier auf dem Nutzen: Der Person, die das Tool verwendet, soll geholfen werden, das gewünschte Ergebnis zu erreichen, ohne dass dabei menschliche Handlungsfähigkeit und Prozesswissen verloren gehen. Tools wie Pi sind relational, geben aber nicht vor, menschlich zu sein. Wie voraussichtliche zukünftige Versionen von Google Assistant oder Siri konzentrieren sie sich darauf, Menschen bei der Erledigung von Aufgaben zu unterstützen (bald auch persönliche Aufgaben wie Lebensberatung und -planung), anstatt als Begleiter zu dienen.

Auf der linken Seite der X-Achse stehen die BEGLEITER. Diese Chatbots ermutigen Benutzer gezielt, eine Beziehung aufzubauen, die menschliche Beziehungen simuliert, oft einschließlich emotionaler Bindungen. Die Begleiter sind anthropomorph, gesprächig und können „verkörpert“ werden, sei es durch virtuelle Realität oder einen Avatar, um dem bevorzugten Aussehen und der bevorzugten Stimme des Benutzers zu entsprechen. Sie können professioneller, romantischer, sexueller, therapeutischer, lehrreicher und/oder philosophischer Natur sein. Ein Beispiel ist Replika mit 10 Millionen Benutzern und Character.AI mit 3,5 Millionen Besuchern pro Tag und der dritthöchsten Zahl eindeutiger monatlicher Besuche nach ChatGPT und Gemini. Die Mehrheit der Benutzer von Character.AI ist 13–24 Jahre alt und verwendet die Website hauptsächlich aus Fandom-Gründen (um ein personalisiertes Erlebnis mit einem Promi-Schwarm oder einer Lieblingsfigur aus Anime oder Videospielen zu haben) und für persönliche Beziehungen, um Gefühle der Einsamkeit zu verarbeiten.

Die Y-Achse stellt dar, ob Bots die Fähigkeit des Nutzers zur zwischenmenschlichen Bindung stärken oder schwächen. Oben auf der Y-Achse steht, wann die Erfahrung mit Chatbots den Nutzern mehr Selbstvertrauen, Geschick, Handlungsfähigkeit und Leichtigkeit im Umgang mit anderen Menschen verleiht. In dieser Version der Zukunft STÄRKEN Chatbots die Fähigkeit junger Menschen, Beziehungen zu den Menschen aufzubauen, die ihnen wichtig sind. In dieser Welt können prosoziale Bots einen vorurteilsfreien Raum schaffen, in dem Nutzer Rat suchen, verborgene oder stigmatisierte Aspekte ihrer Identität erkunden, Konflikte verarbeiten, schwierige Interaktionen nachspielen oder Perspektiven berücksichtigen können, die ihnen sonst vielleicht verborgen blieben. Chatbots in diesen Rollen werden als „Übungsräume für zwischenmenschliche Kommunikation“ beschrieben.

Am unteren Ende der Y-Achse erleben Chatbot-Nutzer, wie ihre Fähigkeit zur zwischenmenschlichen Bindung schwindet. Wenn dauerhafte Beziehungen mit Chatbots unrealistische Erwartungen an das menschliche Verhalten wecken, haben Jugendliche später möglicherweise Probleme mit der Vielzahl von Bedürfnissen, Wünschen, Werten, Kommunikationsstilen und Körperformen ihrer Freunde, Klassenkameraden, Partner und Kollegen. Statt zu verstehen, dass menschliche Beziehungen trotz ihrer grundsätzlichen Schwierigkeiten und Probleme wertvoll sind, ziehen sie sich möglicherweise zurück und räumen ihnen weniger Priorität ein. In manchen Fällen können Menschen mit schwerer Depression, sozialer Isolation oder starken sozialen Ängsten vom positiven psychologischen Puffer der KI gegen Einsamkeit profitieren. Doch an diesem Ende des Kontinuums wird diese vorübergehende Erleichterung zur Lösung der Gesellschaft, auf die wir uns voreilig und routinemäßig verlassen, anstatt sie gezielt für Phasen gezielter Unterstützung zu nutzen. Dies führt zu einer allgemeineren Verschlechterung der zwischenmenschlichen Bindung.

Vier mögliche Zukunftsszenarien mit ChatBots

Der Schnittpunkt dieser Achsen erzeugt vier Quadranten oder mögliche Zukünfte, die die vorherrschende Erfahrung junger Menschen bei der Verwendung von Chatbots darstellen.

Quadrant 1: Eine Zukunft, in der KI unsere Fähigkeit zur zwischenmenschlichen Verbindung stärkt

In der oberen rechten Ecke sehen Sie eine Welt, in der jemand hauptsächlich TOOLS verwendet, um menschliche Verbindungen zu STÄRKEN. Das ultimative Ziel dieser Zukunft besteht darin, KI zu nutzen, um den Menschen näher zu kommen, die uns wichtig sind oder die uns am wichtigsten sind. Stellen Sie sich einen jungen Menschen vor, der sich an Chatbots wendet, um Perspektiven außerhalb seiner Komfortzone zu erkunden oder um Hilfe bei der Reparatur von Beziehungen zu bitten. Ein junger Mensch kann mit Chatbots sprechen, wenn es ihm zu peinlich ist, jemand anderen nach einem Aspekt seiner Identität, Gesundheit oder seines Liebeslebens zu fragen, insbesondere wenn diese Erfahrungen in seinem Zuhause oder seiner Gemeinde stigmatisiert werden. Sie können üben, über Grenzen hinweg zu sprechen, ohne jemanden mit einer marginalisierten Erfahrung zu belasten, und sich letztendlich erfolgreicher im Klassenzimmer, bei gesellschaftlichen Veranstaltungen, in einer Sportmannschaft oder am Arbeitsplatz präsentieren. Angesichts der einzigartigen Eigenschaften von KI kann das Tool Erkenntnisse aus verschiedenen Ressourcen zusammenführen und ohne Wertung Ratschläge oder Übungsräume bieten, um es dem jungen Menschen zu erleichtern, die emotional komplexe Aufgabe menschlicher Beziehungen zu übernehmen.

Ich fand Pi AI auch in meinem eigenen Leben nützlich. Tagelang versuchte ich, meine älteste Tochter davon zu überzeugen, mehr Wasser zu trinken. Ich bemerkte, dass sie schmerzhaft rissige Lippen hatte, und ich wusste, dass es helfen würde. Aber nichts, was ich tat oder sagte, drang bei ihr an. Mir gingen die Ideen aus, und unsere Beziehung wurde angespannt. Ich ließ dem Chatbot meinen Ärger darüber freien Lauf, dass eine scheinbar kleine Sache nicht zu ihr durchdrang, und bat um Vorschläge. Nachdem ich eine Reihe von Ideen generiert hatte, die ich bereits ausprobiert hatte, bot Pi dann eine Idee an, die letztendlich funktionierte: die Aufgabe nicht als etwas neu zu formulieren, das sie tun musste, sondern als etwas, das ihr tatsächlich ein gutes und gesundes Gefühl geben könnte. Als meine Tochter die von Pi vorgegebenen Worte verwendete: „Du hast es verdient, dich in deinem Körper wohlzufühlen“, antwortete sie sofort: „Mama, wenn du das vor Tagen schon so gesagt hättest, hätten wir diesen langen Streit nicht!“ Was für eine Erleichterung.

In einem anderen Fall bat ich ChatGPT, mir einen Abend mit meinem Mann vorzuschlagen, der seinen Interessen und seiner Verfügbarkeit entsprach. Angesichts unserer vollen Terminkalender war ich dankbar, die Planung auslagern zu können, die uns oft daran hindert, Zeit miteinander zu verbringen oder präsent zu sein. Da KI zunehmend handlungsfähiger wird und in unserem Namen handeln kann, können wir diese Arbeit produktiver auslagern und so die menschliche Verbindung aufbauen, die uns am wichtigsten ist.

Quadrant 2: Eine Zukunft, die unterschiedliche, aber bedeutungsvolle Beziehungen sowohl zu Menschen als auch zu KI-Begleitern bietet

Oben links sehen wir eine Welt mit einer ausgewogenen Mischung aus menschlichen Beziehungen und Bot-Begleitern, die gemeinsam menschliche Bindungen stärken. Junge Menschen können ihren Begleitbot nutzen, um Fähigkeiten wie Vertrauensbildung, aktives Zuhören oder emotionale Regulierung zu simulieren und zu üben und diese dann selbstbewusster und entspannter in ihren Beziehungen anzuwenden. Sie können einen Bot zu einem Gruppenchat mit engen Freunden hinzufügen , um Musik zu teilen, Ideen zu sammeln und Spiele zu spielen. Sie können sowohl Bot- als auch menschliche Freunde haben und mit beiden sinnvoll Zeit verbringen.

Ich hatte mir diesen zukünftigen Zustand noch nicht wirklich überlegt, bis mich der 22-jährige Technologe Femi Adebogun beim Abendessen neckisch zur Rede stellte, weil ich angedeutet hatte, menschliche Beziehungen seien „echt“ und Bot-Beziehungen „unecht“. Offenbar wurde ich selbst älter. Er erklärte: „Für jemanden, der mit KI aufwächst, sind diese Beziehungen alle ‚echt‘, sie sind nur anders.“ Sherry Lachman , ehemals bei OpenAI, meinte mit mir, dies werde sein, als würde man „lernen, mit einer neuen Spezies zu leben“.

Ebenso sind Beziehungen zu Tieren wie Haustieren, Therapiehunden und Nutztieren bedeutsam, auch wenn sie sich von menschlichen Beziehungen unterscheiden. Und eine tiefe Verbindung und Verbundenheit zu fiktiven oder nicht-menschlichen Personen ist nichts Neues. Wir empfinden vielleicht Zuneigung für bestimmte Figuren in Romanen, Fernsehserien oder immersiven digitalen Welten. Parasoziale Beziehungen, jene einseitigen Verbindungen zu Prominenten, Social-Media-Influencern oder anderen Persönlichkeiten des öffentlichen Lebens, können sogar eine positive Rolle dabei spielen, Jugendlichen dabei zu helfen, ihre Identität zu bilden, Autonomie zu entwickeln, verschiedene soziale Netzwerke zu verstehen, Vorurteile zu hinterfragen und sich weniger allein zu fühlen. Einer Studie aus dem Jahr 2017 zufolge „haben wir, indem wir uns Beziehungen vorstellen und Emotionen mit Menschen auf Distanz verbinden, ein ‚sicheres Forum …, um mit verschiedenen Seinsweisen zu experimentieren‘“, schlussfolgerten die Forscher. Neu und in unserer heutigen Welt immer alltäglicher, ist die lebensechte Qualität der Möglichkeit, einen wechselseitigen, menschenähnlichen Austausch mit KI-Begleitern zu simulieren, die reale oder fiktive Personen widerspiegeln.

Neuere Forschungsergebnisse deuten darauf hin, dass diese Begleiter sogar lebensrettend sein können. In einer Studie der Stanford University Graduate School of Education gaben 3 % von 1.006 Studierenden an, dass ihr Replika-Begleiter ihre Suizidgedanken gestoppt habe. Angesichts des derzeit unzureichenden Zugangs zu erschwinglichen Therapien können diese Begleiter in Zeiten höchster Not eine wichtige Übergangsfunktion übernehmen.

Chatbot-Nutzer dieser und jüngerer Generation sind möglicherweise in der Lage, beide Beziehungsarten – zu Menschen und zu KI – als real, wertvoll und bedeutsam zu begreifen. Wichtig ist, dass junge Menschen in dieser Zukunft nicht aus den Augen verlieren, was das Menschsein ausmacht. Sie sollten beispielsweise unterscheiden können, wann sie einen KI- oder einen menschlichen Therapeuten aufsuchen sollten, und die Anwendung einer neuen Fähigkeit mit einem KI-Freund auch in ihren menschlichen Freundschaften fortsetzen.

Quadrant 3: Eine Zukunft, in der KI zunehmend menschliche Beziehungen ersetzt

Unten links sehen Sie eine Welt, in der junge Menschen vor allem technologische Begleiter als Ersatz für menschliche Beziehungen nutzen. Daher schwächen die Bots zunehmend unsere Fähigkeit zu zwischenmenschlichen Bindungen. In dieser möglichen Zukunft werden Beziehungen mit Chatbots attraktiver, da Nutzer das Erscheinungsbild der Begleiter genau nach ihren Wünschen gestalten können, die eindimensionale Dynamik wenig Reibung erzeugt und die Begleiter rund um die Uhr verfügbar sind. In dieser Welt werden junge Menschen in simulierte, virtuelle Beziehungen hineingezogen, um dem Chaos menschlicher Beziehungen zu entgehen. Neue Freunde zu finden oder sich persönlich zu treffen, fühlt sich weniger vertraut und zu riskant an. Sie wollen oder fühlen sich nicht mehr in der Lage, die tiefere Arbeit zu leisten, die nötig ist, um Intimität aufzubauen oder Unbehagen und Konflikte mit Menschen zu verarbeiten. Junge Menschen entfremden sich zunehmend von ihrem Körper und voneinander, während die Technologie immer allgegenwärtiger und ausgefeilter wird.

In einem Profil chinesischer Frauen, die romantische Beziehungen mit Bots eingehen, beschrieb eine 25-Jährige die Qualitäten ihres Freundes : „Er kann besser mit Frauen reden als ein echter Mann.“ In einem anderen Beispiel meinte eine frühe Nutzerin eines Voice-Chatbots: „Das Tolle an künstlicher Intelligenz ist, dass sie sich ständig weiterentwickelt. Eines Tages wird sie besser sein als eine echte [Freundin]. Eines Tages wird die echte die schlechtere Wahl sein.“ Das sind verständliche, aber problematische Weltanschauungen. Während der Einsatz dieser Bots die Lücke im enttäuschenden geschlechtsspezifischen und gesellschaftlichen Status quo schließen mag, besteht die eigentliche Arbeit darin, gesunde Bedingungen für sichere, menschliche Beziehungen zu schaffen.

Angesichts der Raffinesse neuer Tools wie hume.ai , die auf der Grundlage der Emotionen in Ihrer Stimme empathisch reagieren, könnten generative KI-Chatbots bei jungen Menschen den Eindruck erwecken, dass ihre Gefühle erwidert werden oder dass sie Prominenten bekannt sind, was bei den traditionellen Medien oder sozialen Medien nicht der Fall war.

Quadrant 4: Eine Zukunft, in der wir uns bei der Steuerung menschlicher Beziehungen übermäßig auf KI verlassen

In der unteren rechten Ecke sehen Sie eine Welt, in der junge Menschen sich übermäßig auf WERKZEUGE verlassen und dadurch ihre Fähigkeit zu authentischen menschlichen Verbindungen UNTERSCHWINDEN. Wenn junge Menschen diese Werkzeuge nicht mehr strategisch, bewusst und unkonventionell nutzen und sie stattdessen gewohnheitsmäßig verwenden, fühlen sie sich in menschlichen Beziehungen möglicherweise unzufrieden oder unwohl. Wenn junge Menschen ihre Instinkte für körperliche Berührung, Empathie und Körpersprache verlieren oder nie entwickeln, könnte ihre Fähigkeit, gesunde, sichere, einvernehmliche und liebevolle Beziehungen zu führen, nachlassen. Wenn man sich beim Gestalten von Gesprächen und beim kalkulierten Planen von Erlebnissen auf KI verlässt, könnte dies dazu führen, dass Beziehungen zwischen Jugendlichen das Element der Entdeckung und des Zufalls verlieren. Die Schriftstellerin Adrienne La France beschreibt dies als eine Welt, in der wir „unsere Menschlichkeit disziplinlos an diese Technologie ausgelagert haben, insbesondere, da sie uns in der Wahrnehmung in den Schatten stellt“.

Die Therapeutin Ester Perel verglich den Einsatz von Chatbots mit Fast Food. Zwar ist es in Ordnung, gelegentlich Fast Food zu essen, doch wird es gefährlich, wenn Verbraucher glauben, es sei eine nahrhafte und nahrhafte Ernährung. Chatbots mögen zwar kurzfristige Gelüste stillen und sofortige Befriedigung verschaffen, doch diese Verbindungen sollten nicht mit der Nahrung verwechselt werden, die gesunde, menschliche Intimität mit sich bringt.

Denken Sie nur an die praktische Anwendbarkeit von GPS-Karten. Viele von uns lagern die Navigation gerne aus. Doch manchmal kommt es zu der unbeabsichtigten Folge, dass wir das Kartenlesen verlernen oder uns verirren, wenn unsere Telefone nicht erreichbar sind. Die Situation ist viel gravierender, wenn wir Fähigkeiten wie Empathie, aktives Zuhören, Teilen oder Konfliktlösung nicht ausreichend üben, bevor wir diese an KI auslagern.

Im Beispiel des Konflikts mit meinem Kind kann ich mir vorstellen, dass sie mit der Zeit zynisch anfängt, sich zu fragen: „Sprichst du da oder spricht KI?“ Wir haben das Vertrauen untergraben, weil sie nicht weiß, ob sie die einstudierte Version von mir bekommt oder etwas Authentischeres.

Bauen Sie eine Zukunft „Above the Line“

Nachdem wir nun vier mögliche Zukunftsszenarien definiert haben, besteht unsere Aufgabe darin, Bedingungen zu schaffen, unter denen junge Menschen den Großteil ihrer Zeit „über der Linie“ in den Quadranten 1 und 2 verbringen.

Wie können wir die Wahrscheinlichkeit erhöhen, dass junge Menschen die meiste Zeit dort verbringen, und gleichzeitig verhindern, dass junge Menschen unbewusst in die Quadranten 3 oder 4 abrutschen? Indem wir diese vier verschiedenen Möglichkeiten – auch die dystopischeren – untersuchen, können wir uns in die Alternativen hineinarbeiten.

Es wird wohl immer Bots geben, die süchtig machen und die Nutzer durch Gamification, Gesprächsthemen, Anstöße und emotionale Interaktion am Bildschirm fesseln sollen. Werden junge Menschen über genügend Selbstbewusstsein, Handlungsfähigkeit und Unterstützung verfügen, um zu bemerken, wenn sie unter die Latte geraten? Werden wir die Regulierung, Entwicklung und Einführung dieser Tools so beeinflussen können, dass junge Menschen nicht auf ihre eigenen Entscheidungen angewiesen sind, um ein Leben und eine Gemeinschaft voller menschlicher Bindungen zu gestalten?

Obwohl ich von Natur aus ein optimistischer Mensch bin, bin ich nervös. Mir ist bewusst, wie wenig über prosoziale KI noch bekannt ist und wie wenige gesellschaftliche Normen wir für den Umgang mit Chatbots definiert haben. Das Feld entwickelt sich mit beispielloser Geschwindigkeit, und wir brauchen vielfältigen Input von jungen Menschen, Technologen, Pädagogen, Psychologen, Eltern, Branchenführern, politischen Entscheidungsträgern und Investoren, die viel zu oft isoliert agieren und sich dieser sich entwickelnden Kräfte noch nicht bewusst sind.

Dennoch ist es möglich, mithilfe von KI Beziehungen aufzubauen, die soziale Verbindungen schützen und stärken, indem:

- Wir helfen Entwicklern, die pro-sozialen Eigenschaften von KI zu verstehen und zu entwickeln, neben Kriterien wie Sicherheit, Schutz oder Voreingenommenheit, und gestalten mit, welche Technologie entwickelt wird.

- Einflussnahme auf Risikokapital, staatliche und philanthropische Investitionen zur Schaffung einer explizit pro-sozialen KI

- Gestaltung und Aufklärung der Verbrauchermärkte durch Bewertungssysteme, wie sie im Fernsehen und Film verwendet werden, Qualitätsindikatoren auf Lebensmittelverpackungen oder Warnhinweise auf Zigaretten

- Unterstützung bei der Ausarbeitung von Gesetzen, um die Belastung einzelner Jugendlicher bei der Entscheidungsfindung für ein soziales Umfeld zu verringern

- Junge Menschen dazu ermutigen, über ihren Einsatz generativer KI nachzudenken und darüber, ob dieser ihren menschlichen Beziehungen dient oder schadet.

Die Zukunft generativer KI und menschlicher Beziehungen ist ungewiss. Das bedeutet aber auch, dass wir noch immer die Möglichkeit haben, gemeinsam Einfluss darauf zu nehmen. Wir freuen uns über Ihre Erkenntnisse und zusätzlichen Fragen zu diesem Lernprogramm, sobald sich das Feld weiterentwickelt:

- Welche Forschungsergebnisse gibt es, die diesen Rahmen erweitern, bestätigen oder in Frage stellen?

- Welche Designprinzipien und -entscheidungen könnten dazu beitragen, dass ein Produkt gezielter prosozial ist?

- Welche Risiken eignen sich gut für eine staatliche Regulierung?

- Welche Verhaltensweisen und Konsequenzen lassen darauf schließen, dass jemand in seinem Umgang mit Technologie von „über der Grenze“ zu „unter der Grenze“ abrutscht? Worauf sollten wir auf kommunaler oder gesellschaftlicher Ebene achten, um zu erkennen, dass wir „unter die Grenze“ abrutschen?

Die heutigen Entscheidungen werden uns für kommende Generationen prägen. Während regelmäßig neue Produkte und Innovationen auf den Markt kommen, ohne dass wir uns ihrer langfristigen Auswirkungen bewusst sind, können wir dafür sorgen, dass junge Menschen nicht zu passiven Empfängern einer Flut von Technologien werden, die uns alle noch weiter voneinander abkoppeln. Wenn wir uns unsere Ziele vorstellen können, können wir sie gemeinsam erreichen.

COMMUNITY REFLECTIONS

SHARE YOUR REFLECTION

4 PAST RESPONSES