Face à la multiplication des crises de santé mentale chez les jeunes et à la montée de la solitude, les technologues, les investisseurs et les développeurs de produits s'empressent de créer des produits d'IA générative pour combler le manque de relations humaines. Nous avons déjà des chatbots thérapeutes, des petites amies et des tuteurs, et le rythme des nouveaux développements est stupéfiant. L'IA se rapproche de plus en plus de l'humain (pensez au mode vocal amélioré imminent de GPT-4o) et, dans bien des cas, surpasse les capacités humaines . Les jeunes d'aujourd'hui font de moins en moins la différence entre les relations « réelles » (un ami rencontré sur le terrain de jeu), les relations numériques (un ami rencontré en jouant à Fortnite) et les relations avec un robot (un ami non humain).

Dans ma vie personnelle et professionnelle, j'ai constaté le potentiel des chatbots pour développer le potentiel humain : j'ai utilisé Playlab.ai pour libérer l'autonomie des jeunes tout en dirigeant le laboratoire de réinvention de Teach For America et j'ai même expérimenté un bot Replika (avec la bénédiction de mon mari et sa curiosité partagée pour cette avancée technologique). Bientôt, ces bots pourront alimenter des avatars dans des expériences de réalité mixte, apparaître de manière plus réaliste dans les jeux et les expériences que nous connaissons et apprécions, se faufiler sur les réseaux sociaux et continuer à brouiller les pistes avec la réalité.

Mais lorsque les enjeux pour le bien-être des jeunes et la cohésion sociale générale sont si élevés, il est essentiel de donner la priorité à l’IA prosociale et aux relations avec les chatbots qui améliorent – plutôt qu’érodent – notre capacité de connexion humaine.

La recherche en développement humain et les neurosciences nous apprennent que les humains commencent à s'adapter aux besoins, à la voix, au toucher et au langage corporel des autres dès la petite enfance. Ce processus, appelé harmonisation sociale, joue un rôle essentiel dans la promotion d'un développement social sain, notamment dans le développement de l'empathie, de compétences de communication efficaces et de relations interpersonnelles solides. En tant qu'êtres sociaux et incarnés, nous apprenons, grandissons, nous adaptons, nous guérissons et célébrons en communauté. Nous progressons en tant que société lorsque nous nous sentons inspirés et responsables du bien-être d'autrui. Même si notre définition des relations humaines évolue pour tenir compte des opportunités significatives de connexion numérique avec autrui, la prochaine génération pourrait se sentir moins connectée à elle-même, aux autres et aux qualités qui nous caractérisent si les relations robotisées remplacent ou éclipsent les relations humaines.

Heureusement, l'avenir n'est pas encore là, nous pouvons donc encore le façonner pour qu'il nourrisse la capacité des jeunes à nouer des liens humains. Depuis des mois, je rencontre des éducateurs, des technologues, des jeunes militants, des professionnels de la santé mentale, des investisseurs, des chercheurs et des acteurs de la communauté de premier plan afin d'explorer les futurs possibles des chatbots. L'optimisme réside dans notre capacité à imaginer des relations idéales avec l'IA et à aider les jeunes à naviguer dans cette nouvelle vague de robots. Si nous y parvenons, nous préserverons et vivrons plus pleinement notre humanité.

Évaluer les qualités prosociales des chatbots

Les créateurs et investisseurs technologiques responsables prennent déjà en compte les critères de sécurité, de protection des données, de confidentialité, de partialité et d'accès équitable. Nous devons également commencer à mesurer et à définir les capacités prosociales de l'IA comme critères d'investissement et de développement.

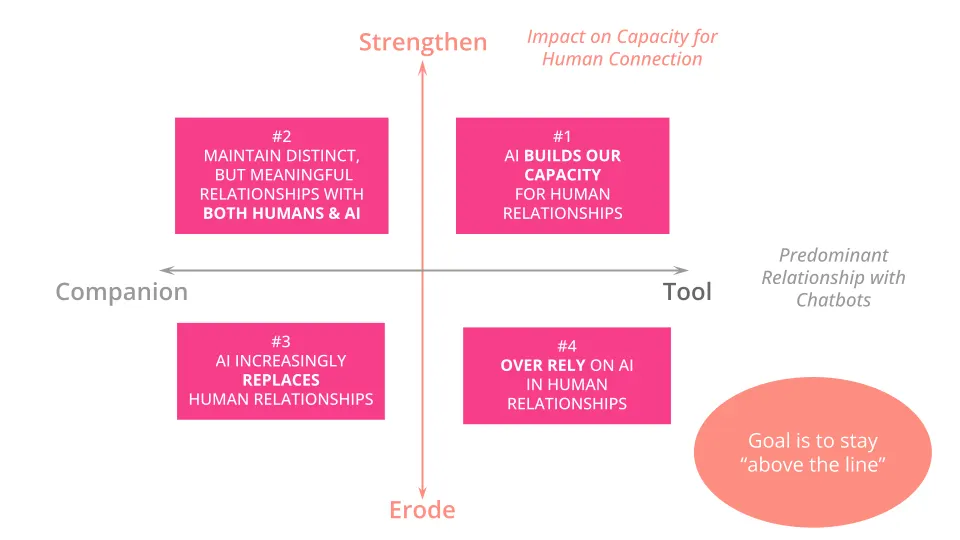

J'ai créé une ressource pour imaginer de manière proactive comment les jeunes pourraient interagir avec les chatbots et les utiliser, avec différents impacts sur les relations humaines. Le cadre ci-dessous cartographie quatre futurs possibles, chacun représentant l'expérience la plus courante des chatbots chez les jeunes.

L’axe des X représente la relation prédominante des jeunes avec les chatbots.

À droite de l'axe des X se trouvent les OUTILS. Ces chatbots aident les utilisateurs à accomplir une tâche ou un ensemble de tâches. Bien qu'ils soient de nature conversationnelle (comme ChatGPT4), ils ne sont pas explicitement conçus pour reproduire une relation émotionnelle. Les utilisateurs obtiennent un service de l'outil, qu'ils peuvent ensuite appliquer dans le monde humain. Ici, l'accent est mis sur l'utilité : aider l'utilisateur à atteindre le résultat souhaité tout en préservant l'action humaine et les connaissances acquises. Des outils comme Pi sont relationnels, mais ne prétendent pas être humains. À l'instar des futures versions de Google Assistant ou de Siri, ils se concentrent sur l'aide à l'accomplissement de tâches humaines (qui incluront bientôt des tâches personnelles comme donner des conseils et planifier), plutôt que de servir de compagnon.

À gauche de l'axe des X se trouvent les COMPAGNONS. Ces chatbots encouragent intentionnellement les utilisateurs à entretenir une relation qui simule les relations humaines, incluant souvent des liens affectifs. Les compagnons sont anthropomorphes, conversationnels et peuvent être « incarnés », que ce soit par la réalité virtuelle ou un avatar, pour correspondre à l'apparence et à la voix préférées de l'utilisateur. Ils peuvent être professionnels, romantiques, sexuels, thérapeutiques, instructifs et/ou philosophiques. Citons Replika, qui compte 10 millions d'utilisateurs, et Character.AI, qui enregistre 3,5 millions de visiteurs quotidiens et se classe au troisième rang en nombre de visites uniques mensuelles derrière ChatGPT et Gemini. La majorité des utilisateurs de Character.AI ont entre 13 et 24 ans et l'utilisent principalement pour le fandom (vivre une expérience personnalisée avec une célébrité ou un personnage d'anime ou de jeu vidéo préféré) et pour des relations personnelles afin de surmonter leur sentiment de solitude.

L'axe des Y représente si les bots renforcent ou affaiblissent la capacité de l'utilisateur à établir des relations humaines. En haut de l'axe des Y, on observe quand l'interaction avec les chatbots apporte aux utilisateurs plus de confiance, de compétences, d'autonomie et de facilité à entrer en relation et à se connecter avec d'autres humains. Dans cette version du futur, les chatbots RENFORCENT la capacité des jeunes à établir des relations avec les personnes qui leur sont chères. Dans ce monde, les bots prosociaux peuvent créer un espace exempt de jugement où les utilisateurs peuvent demander conseil, explorer des aspects cachés ou stigmatisés de leur identité, résoudre des conflits, mettre en scène une interaction difficile ou envisager des perspectives auxquelles ils ne seraient peut-être pas exposés autrement. Les chatbots dans ces rôles ont été décrits comme des « espaces de répétition pour la communication interpersonnelle ».

Au bas de l'axe des Y se trouve le moment où les utilisateurs de chatbots voient leur capacité à nouer des relations humaines s'éroder. Si les relations suivies avec les chatbots créent des attentes irréalistes quant à la manière dont les humains devraient être, les jeunes pourraient plus tard être confrontés à la multitude de besoins, de désirs, de valeurs, de styles de communication et d'apparences physiques de leurs amis, camarades de classe, amants et collègues. Plutôt que de comprendre que les relations humaines sont précieuses, malgré leur complexité et leur complexité intrinsèques, ils risquent de se replier sur elles-mêmes et de les reléguer au second plan. Dans certains cas, les personnes souffrant de dépression profonde, d'isolement social ou d'anxiété sociale sévère peuvent bénéficier du tampon psychologique positif de l'IA contre la solitude. Pourtant, à cette extrémité du continuum, ce soulagement temporaire devient une solution de société sur laquelle nous nous appuyons prématurément et systématiquement, plutôt que de l'exploiter intentionnellement pendant des périodes de soutien planifié, ce qui entraîne une dégradation plus globale des relations humaines.

Quatre futurs possibles avec les chatbots

L’intersection de ces axes crée quatre quadrants ou futurs possibles, représentant l’expérience prédominante des jeunes utilisant des chatbots.

Quadrant 1 : Un avenir où l’IA renforce notre capacité de connexion interhumaine

En haut à droite, on découvre un monde où l'on utilise principalement des OUTILS pour RENFORCER les liens humains. L'objectif ultime de ce futur est d'exploiter l'IA pour se rapprocher des personnes qui nous sont chères ou que nous souhaitons privilégier. Imaginez un jeune qui se tourne vers les chatbots pour explorer des perspectives hors de sa zone de confort ou demander de l'aide pour renouer des relations. Un jeune peut s'adresser aux chatbots s'il est trop gêné pour interroger quelqu'un sur un aspect de son identité, de sa santé ou de sa vie amoureuse, surtout si ces expériences sont stigmatisées chez lui ou dans sa communauté. Il peut s'exercer à parler au-delà des différences sans accabler quelqu'un d'une expérience marginalisée et, au final, être plus performant en classe, lors d'événements sociaux, au sein d'une équipe sportive ou au travail. Grâce aux caractéristiques uniques de l'IA, cet outil peut synthétiser les connaissances issues de différentes ressources et proposer des conseils ou un espace de pratique sans jugement, facilitant ainsi l'apprentissage de la complexité émotionnelle des relations humaines.

J'ai trouvé l'IA Pi utile dans ma vie. Pendant des jours, j'ai essayé de convaincre ma fille aînée de boire plus d'eau. J'ai remarqué qu'elle avait les lèvres douloureusement gercées et je savais que cela l'aiderait. Mais rien de ce que je faisais ou disais ne lui faisait de l'effet. J'étais à court d'idées et notre relation devenait tendue. J'ai confié au chatbot que quelque chose d'apparemment anodin ne passait pas et j'ai demandé des suggestions. Après avoir proposé une série d'idées que j'avais déjà essayées, Pi en a proposé une qui a finalement fonctionné : reformuler la tâche non pas comme quelque chose qu'elle devait faire, mais comme quelque chose qui pourrait réellement lui apporter bien-être et santé. En utilisant le langage suggéré par Pi : « Tu mérites de te sentir bien dans ton corps », ma fille a immédiatement répondu : « Maman, si tu l'avais dit comme ça il y a quelques jours, on n'aurait pas eu cette longue dispute ! » Quel soulagement.

Dans un autre cas, j'ai demandé à ChatGPT de me suggérer une soirée en amoureux avec mon mari, en fonction de ses centres d'intérêt et de ses disponibilités. Compte tenu de nos emplois du temps chargés, j'étais ravie de pouvoir externaliser la planification, qui nous empêche souvent de prioriser le temps passé ensemble ou d'être présent. L'IA devenant de plus en plus réactive et capable d'agir en notre nom, nous pouvons externaliser davantage de tâches de manière productive pour favoriser les relations humaines auxquelles nous tenons tant.

Quadrant 2 : Un avenir qui offre des relations distinctes, mais significatives, avec les humains et les compagnons IA

En haut à gauche, nous découvrons un monde où règnent un équilibre entre relations humaines et compagnons robots qui, ensemble, renforcent les liens humains. Les jeunes peuvent utiliser leur compagnon robot pour simuler et pratiquer des compétences liées à la création de liens, à l'écoute active ou à la régulation émotionnelle, puis les appliquer avec plus d'assurance et d'aisance dans leurs relations humaines. Ils peuvent intégrer un robot à un groupe de discussion avec leurs amis proches pour partager de la musique, trouver des idées et jouer à des jeux. Ils peuvent avoir des amis robots et des amis humains, et passer du temps utile avec chacun.

Je n'avais pas pleinement envisagé cet avenir avant que Femi Adebogun , un technologue de 22 ans, ne me taquine, au cours d'un dîner, pour avoir insinué que les relations humaines étaient « réelles » et celles entre robots « fausses ». Apparemment, je vieillissais moi-même. Il m'a expliqué : « Pour quelqu'un qui grandit avec l'IA, ces relations sont toutes “réelles”, elles sont juste différentes. » Sherry Lachman , ancienne d'OpenAI, m'a expliqué que ce serait comme « apprendre à vivre aux côtés d'une nouvelle espèce ».

De même, les relations avec les animaux, comme les animaux de compagnie, les chiens de thérapie et les animaux de ferme, sont significatives, même si elles sont distinctes des relations humaines. L'attachement profond à des personnages fictifs ou non humains n'est pas nouveau. Nous pouvons éprouver de l'affection pour certains personnages de romans, de séries télévisées ou d'univers numériques immersifs. Les relations parasociales, ces liens à sens unique noués avec des célébrités, des influenceurs des réseaux sociaux ou d'autres personnalités publiques, peuvent même jouer un rôle positif pour aider les adolescents à construire leur identité, à développer leur autonomie, à comprendre différents réseaux sociaux, à remettre en question leurs préjugés et à se sentir moins seuls. Selon une étude de 2017 , « En imaginant des relations et en associant des émotions à des personnes à distance, nous disposons d'un espace sécurisé… pour expérimenter différentes manières d'être », concluent les chercheurs. Ce qui est nouveau et de plus en plus courant dans notre monde actuel, c'est la possibilité de simuler un échange bidirectionnel, de type humain, avec des compagnons IA qui reflètent des personnes réelles ou fictives. »

Des recherches récentes indiquent que ces accompagnants pourraient même sauver des vies. Dans une étude menée par la faculté d'éducation de l'université de Stanford, 3 % des 1 006 étudiants utilisateurs de Replika ont déclaré que leur accompagnant Replika avait mis fin à leurs idées suicidaires . Compte tenu du manque actuel d'accès à des thérapies abordables, ces accompagnants peuvent jouer un rôle de transition important dans un contexte de besoin crucial.

Les utilisateurs de chatbots de cette génération et des générations plus jeunes sont peut-être particulièrement bien placés pour comprendre les deux types de relations, avec les humains et avec l'IA, comme réelles, précieuses et significatives. Il est important de veiller, dans cette version du futur, à ce que les jeunes ne perdent pas de vue ce qui compte le plus en tant qu'être humain. Par exemple, ils devraient être capables de différencier quand consulter un thérapeute IA ou un thérapeute humain, et continuer à appliquer la pratique d'une nouvelle compétence avec un ami IA à leurs amitiés humaines.

Quadrant 3 : Un avenir où l’IA remplace de plus en plus les relations humaines

En bas à gauche, nous découvrons un monde où les jeunes utilisent principalement des COMPAGNONS technologiques pour remplacer les relations humaines. Par conséquent, les bots érodent de plus en plus notre capacité à établir des liens humains. Dans ce futur possible, les relations avec les chatbots deviennent privilégiées, car les utilisateurs peuvent personnaliser l'apparence et l'atmosphère de leur compagnon à leur guise, il y a peu de frictions dans cette dynamique unidimensionnelle et les compagnons sont disponibles à la demande à tout moment de la journée. Dans ce monde, les jeunes sont attirés par des relations virtuelles simulées pour éviter le chaos des relations humaines. Se faire de nouveaux amis ou être en personne commence à leur paraître moins familier et trop risqué. Ils ne désirent plus ni ne se sentent capables de faire le travail en profondeur nécessaire pour créer une intimité ou surmonter l'inconfort et les conflits avec les humains. Les jeunes se déconnectent de plus en plus de leur corps et des autres à mesure que la technologie devient omniprésente et sophistiquée.

Dans un portrait de femmes chinoises choisissant des relations amoureuses avec des robots, une jeune femme de vingt-cinq ans décrivait les qualités de son petit ami : « Il sait mieux parler aux femmes qu’un vrai homme. » Autre exemple : un utilisateur précoce d’un chatbot vocal remarquait : « Ce qui est formidable avec l’IA, c’est qu’elle évolue constamment. Un jour, elle sera meilleure qu’une vraie [petite amie]. Un jour, la vraie sera le choix le plus faible. » Ces visions du monde sont compréhensibles, mais problématiques. Si l’imposition de ces robots peut combler le vide laissé par un statu quo sociétal et genré décevant, le véritable objectif est de créer des conditions saines pour des relations humaines et sûres.

Étant donné la sophistication des outils émergents comme hume.ai qui répondent avec empathie en fonction de l'émotion dans votre voix, les chatbots d'IA générative peuvent laisser les jeunes croire que leurs sentiments sont réciproques ou qu'ils sont connus par des célébrités d'une manière que les médias traditionnels ou les médias sociaux ne connaissaient pas.

Quadrant 4 : Un avenir où nous dépendrons excessivement de l’IA pour guider les relations humaines

En bas à droite, nous découvrons un monde où les jeunes dépendent excessivement des OUTILS, ce qui affaiblit leur capacité à nouer des relations humaines authentiques. Si les jeunes ne sont plus stratégiques, intentionnels et circonscrits dans leur utilisation de ces outils et commencent à les utiliser régulièrement, ils risquent de se sentir insatisfaits ou mal à l'aise dans leurs relations humaines. Si les jeunes perdent ou ne développent jamais leurs instincts de contact physique, d'empathie et de langage corporel, leur capacité à entretenir des relations saines, sûres, consensuelles et aimantes pourrait diminuer. Le recours à l'IA pour scénariser les conversations et planifier les expériences de manière calculée pourrait faire perdre aux relations entre jeunes leur dimension de découverte et de sérendipité. L'écrivaine Adrienne La France décrit ce monde comme un monde où nous avons « externalisé notre humanité à cette technologie sans discipline, d'autant plus qu'elle nous éclipse en termes d'aperception ».

La thérapeute Ester Perel a comparé l'utilisation des chatbots à celle de la restauration rapide. S'il est acceptable de consommer occasionnellement de la restauration rapide, cela devient dangereux si les consommateurs finissent par croire qu'il s'agit d'un régime alimentaire nutritif et nourrissant. Les chatbots peuvent satisfaire des envies passagères et procurer une satisfaction immédiate, mais ces liens ne doivent pas être confondus avec les bienfaits d'une intimité humaine saine.

Pensez à l'aspect pratique des cartes GPS, où beaucoup d'entre nous sont ravis de sous-traiter la navigation. Mais il arrive parfois que nous oubliions de lire les cartes ou que nous nous perdions si notre téléphone n'est pas disponible. Les enjeux sont bien plus importants si nous ne maîtrisons pas suffisamment des compétences comme l'empathie, l'écoute active, le partage ou la résolution de conflits avant de confier ces tâches à l'IA.

Dans l'exemple du conflit avec mon enfant, j'imagine qu'avec le temps, elle commencerait à se demander cyniquement : « C'est toi qui parles ou l'IA qui parle ? » Nous avons érodé la confiance parce qu'elle ne sait pas si elle entend ma version répétée ou quelque chose de plus authentique.

Construire un avenir « Above the Line »

Maintenant que nous avons défini quatre futurs possibles, notre mission est de créer les conditions dans lesquelles les jeunes passent la majorité de leur temps « au-dessus de la ligne » dans les quadrants 1 et 2.

Comment pouvons-nous accroître la probabilité que les jeunes y passent la majeure partie de leur temps et éviter un monde où ils glisseraient inconsciemment vers les quadrants 3 ou 4 ? En explorant ces quatre possibilités, y compris les plus dystopiques, nous pouvons agir pour trouver des alternatives.

Il y aura probablement toujours des bots conçus pour créer une dépendance et maintenir les utilisateurs rivés sur l'écran grâce à la gamification, aux accroches conversationnelles, aux incitations et à l'engagement émotionnel. Les jeunes auront-ils suffisamment de conscience d'eux-mêmes, d'autonomie et de soutien pour remarquer leurs dérives ? Serons-nous capables d'influencer la réglementation, le développement et l'adoption de ces outils afin que les jeunes ne dépendent pas de leurs propres choix pour construire une vie et une communauté emplies de liens humains ?

Bien que je sois de nature optimiste, je suis nerveux. Je suis conscient du peu d'informations disponibles sur l'IA prosociale et du peu de normes sociétales définies concernant le temps passé avec les chatbots. Ce domaine évolue à une vitesse sans précédent, et nous avons besoin de contributions diverses de la part des jeunes, des technologues, des éducateurs, des professionnels de la santé mentale, des parents, des leaders de l'industrie, des décideurs politiques et des investisseurs, qui sont trop souvent cloisonnés et ignorent encore ces forces en évolution.

Il est pourtant possible de créer des relations avec l’IA qui protègent et construisent des liens sociaux en :

- Aider les développeurs à comprendre et à concevoir les qualités prosociales de l'IA, ainsi que des critères tels que la sécurité, la sûreté ou les préjugés, et à façonner la technologie développée

- Influencer le capital-risque, le gouvernement et les investissements philanthropiques vers la création d'une IA plus explicitement prosociale

- Façonner et éduquer les marchés de consommation au moyen de systèmes de notation tels que ceux utilisés à la télévision et au cinéma, d'indicateurs de qualité sur les emballages alimentaires ou d'étiquettes d'avertissement sur les cigarettes

- Aider à la création de lois visant à alléger le fardeau qui pèse sur les jeunes lorsqu'ils doivent faire des choix prosociaux

- Encourager les jeunes à réfléchir à leur utilisation de l’IA générative et à se demander si elle sert ou nuit à leurs relations humaines.

L'avenir de l'IA générative et des relations humaines est incertain. Mais cela signifie aussi que nous avons encore la possibilité d'influencer ce domaine ensemble. À mesure que ce domaine émerge, nous vous invitons à partager vos idées et à nous poser d'autres questions pour enrichir ce programme d'apprentissage :

- Quelles recherches existent qui étendent, valident ou remettent en question ce cadre ?

- Quels sont les principes et les choix de conception qui pourraient aider un produit à être plus intentionnellement prosocial ?

- Quels risques se prêtent le mieux à une réglementation gouvernementale ?

- Quels sont les comportements et les conséquences à surveiller qui suggèrent qu'une personne passe d'une situation « au-dessus de la limite » à une situation « en dessous de la limite » dans sa relation avec la technologie ? À quoi devons-nous prêter attention au niveau communautaire ou sociétal pour indiquer que nous passons « en dessous de la limite » ?

Les choix d'aujourd'hui auront un impact sur les générations à venir. Alors que de nouveaux produits et innovations sont lancés régulièrement sans que l'on ait une idée précise de leur impact, nous pouvons veiller à ce que les jeunes ne deviennent pas les bénéficiaires passifs d'un flot de technologies qui nous déconnecte encore davantage. Si nous pouvons imaginer ce que nous voulons, nous pouvons le réaliser ensemble.

COMMUNITY REFLECTIONS

SHARE YOUR REFLECTION

4 PAST RESPONSES